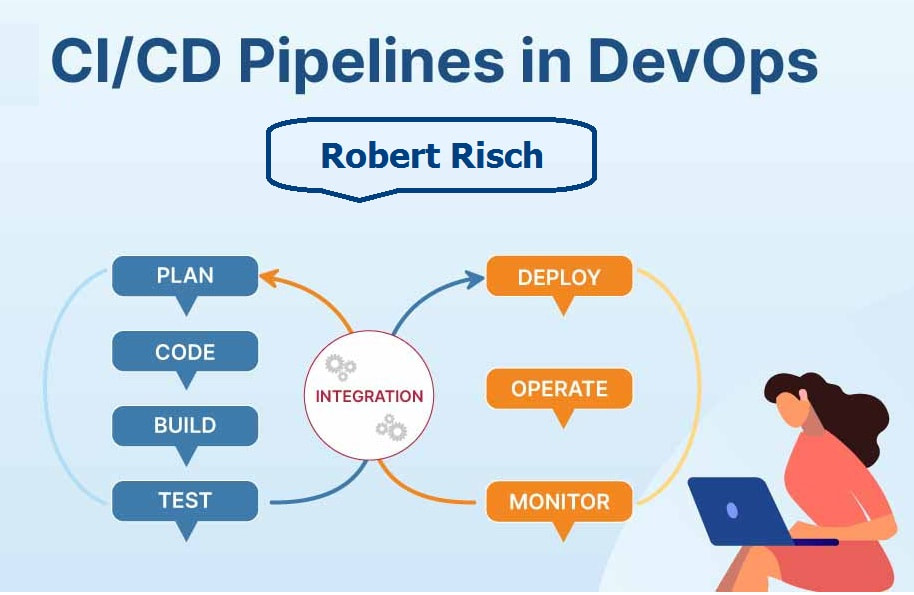

Das Erreichen von Spitzenleistungen in der Softwareentwicklung ist eine kontinuierliche Reise, die durch die Beherrschung bewährter Verfahren gekennzeichnet ist. Bei überlegener Software geht es nicht nur um Funktionalität, sondern auch um Zuverlässigkeit, Wartbarkeit und Skalierbarkeit. In dieser Untersuchung befassen wir uns mit den wichtigsten Praktiken, die, wenn sie beherrscht werden, die Software auf ein höheres Niveau heben. Kodierungsstandards - Exzellenz von Anfang an Das Herzstück überlegener Software ist die Einhaltung von Codierungsstandards. Konsistenter und sauberer Code ist der Grundstein für Wartbarkeit und Lesbarkeit. GitOps - Revolutionierung der kontinuierlichen Bereitstellung GitOps ist ein revolutionärer Ansatz für Continuous Delivery, bei dem die Versionskontrolle im Mittelpunkt steht. Die Beherrschung von GitOps rationalisiert nicht nur die Entwicklungsabläufe, sondern sorgt auch für Transparenz, Zusammenarbeit und die Möglichkeit, jede Änderung während der gesamten Entwicklung der Software nachzuvollziehen. Automatisiertes Testen - Der Wächter der Software-Integrität Automatisiertes Testen ist der Wächter, der die Integrität hochwertiger Software aufrechterhält. Die Beherrschung des Entwurfs und der Implementierung einer umfassenden Testreihe, einschließlich Unit-, Integrations- und End-to-End-Tests, gewährleistet Robustheit und Zuverlässigkeit in jeder Codezeile. Kontinuierliche Integration Kontinuierliche Integration ist die Kunst, Qualität in die Softwareentwicklung zu integrieren. Die Beherrschung von CI-Praktiken beinhaltet die nahtlose Integration von Codeänderungen, die Automatisierung von Builds und die Durchführung von Tests, um schnelles Feedback zu erhalten. Die Beherrschung von Best Practices ist eine transformative Reise zur Bereitstellung hervorragender Software. Wenn Sie sich auf diese Reise begeben, denken Sie daran, dass die Beherrschung kein Ziel ist, sondern ein kontinuierliches Streben nach Verbesserung.

0 Comments

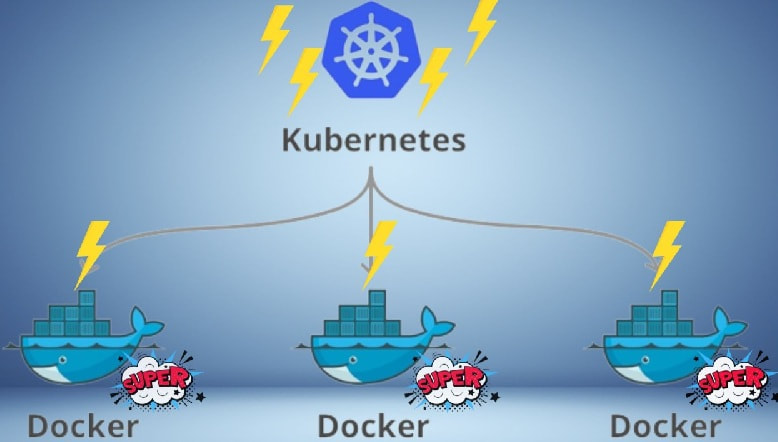

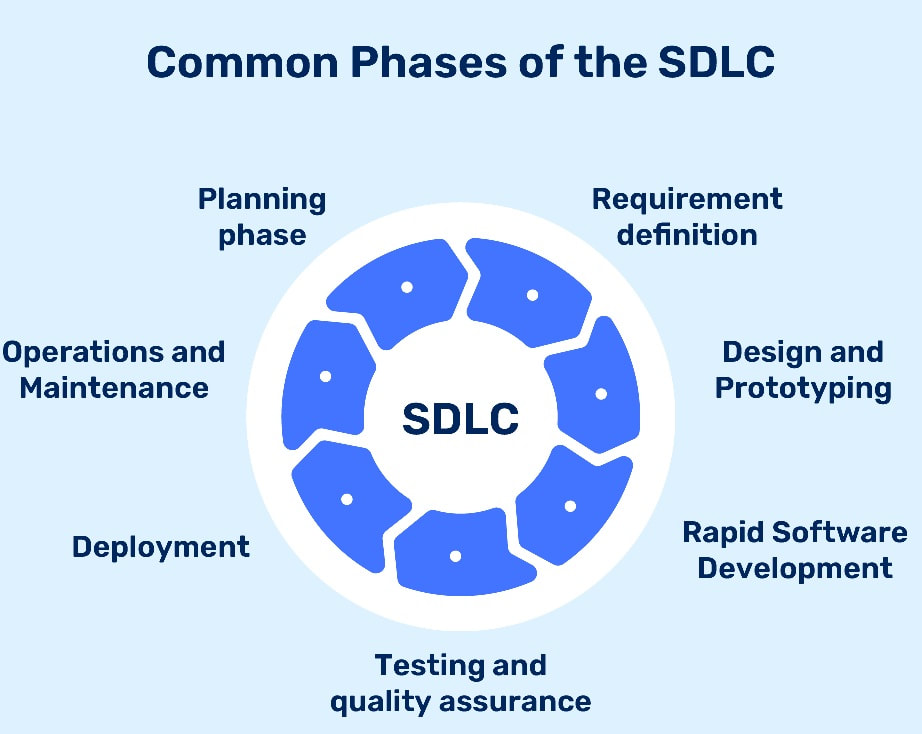

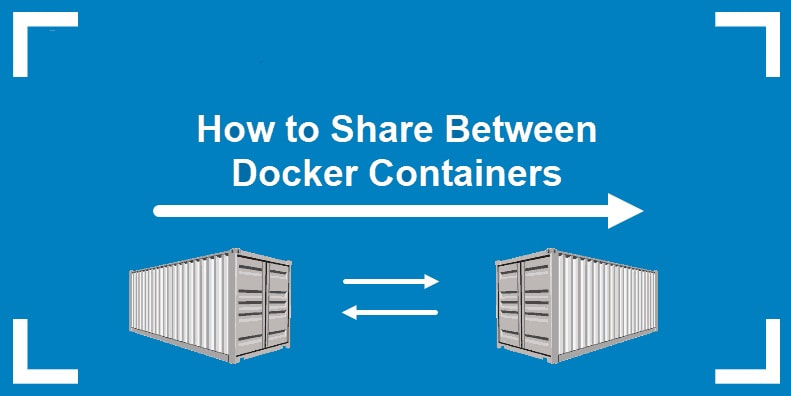

Die Qualität der Software ist ein direkter Ausdruck des Engagements für bewährte Verfahren, Zusammenarbeit und unablässiges Streben nach Verbesserung. Wir befassen uns mit den Strategien und Praktiken, die die Qualität Ihrer Software erheblich verbessern können. Kodierungsstandards - Der Grundstein für Qualität Eine solide Grundlage beginnt mit Kodierungsstandards. Konsistenter, gut organisierter Code verbessert nicht nur die Lesbarkeit, sondern schafft auch die Voraussetzungen für eine einfachere Zusammenarbeit. GitOps - Ein Paradigmenwechsel in der kontinuierlichen Bereitstellung GitOps stellt einen transformativen Ansatz für Continuous Delivery (CD) dar, indem es die Versionskontrolle als Kernstück zentralisiert. Diese Praxis bietet nicht nur eine systematische Möglichkeit, Änderungen zu verfolgen, sondern fördert auch die Zusammenarbeit und Transparenz. Automatisiertes Testen - Sicherstellung der Qualität Automatisiertes Testen ist ein Hüter der Qualität in der Softwareentwicklung. Eine umfassende Suite von Tests, einschließlich Unit-Tests, Integrationstests und End-to-End-Tests, fungiert als Sicherheitsnetz und fängt Probleme frühzeitig im Entwicklungsprozess auf. Kontinuierliche Integration (CI) - Qualität in das Gewebe einweben Kontinuierliche Integration (Continuous Integration, CI) ist ein wichtiges Verfahren, das die Qualität in die Softwareentwicklung einfließen lässt. Durch die häufige und automatische Integration von Codeänderungen rationalisieren CI-Pipelines die Build- und Testprozesse und geben den Entwicklern schnelles Feedback. Dokumentation - Ein Leitfaden zum Verstehen Umfassende Dokumentation ist ein oft übersehener Aspekt der Softwarequalität. Ein gut dokumentierter Code und eine gut dokumentierte Systemarchitektur dienen als Leitfaden für Entwickler und verbessern die Wartbarkeit, die Zusammenarbeit und den Wissensaustausch.  Continuous Delivery (CD) pipeline kan de motor zijn die je team naar succes stuwt. Gaat in op de fijne kneepjes van het ontwerpen van een Continuous Delivery pijplijn, met de nadruk op de dubbele doelstelling van snelheid en betrouwbaarheid. De Continuous Delivery Pipeline begrijpen Belangrijkste onderdelen en fasen Een Continuous Delivery pijplijn is een reeks geautomatiseerde stappen die code doorloopt van ontwikkeling naar productie. Inzicht in deze stappen is cruciaal voor het optimaliseren van het hele proces. Broncodebeheer (SCM) Efficiënt versiebeheer is het fundament van een CD-pijplijn. Ontdek hoe het juiste SCM-systeem de samenwerking kan verbeteren en workflows kan stroomlijnen. Geautomatiseerd testen Duik in de verschillende soorten geautomatiseerde tests - unit, integratie en end-to-end - en hun rol in het waarborgen van de kwaliteit van de code in elke fase. Implementatie Bespreek deployment strategieën en hoe deze het release proces beïnvloeden. Parallellisatie en Concurrency Snelheid is vaak een kwestie van parallellisatie. Ontdek hoe het opsplitsen van taken en het gelijktijdig uitvoeren ervan de bouwtijd aanzienlijk kan verkorten. Afhankelijkheden beheren Bespreek strategieën om efficiënt om te gaan met afhankelijkheden om een soepele parallelle uitvoering mogelijk te maken. Schaalbaarheid Verken hoe de pijplijn horizontaal kan worden geschaald om groeiende werklasten aan te kunnen. Build-processen optimaliseren Het bouwproces is een kritisch aspect van snelheid in de CD-pijplijn. Leer hoe u buildscripts kunt optimaliseren, buildcaches kunt gebruiken en gebruik kunt maken van containerisatie. Containerisatie Begrijp de voordelen van containerisatie bij het maken van reproduceerbare en portable builds. Build Script Efficiëntie Ontdek technieken voor het stroomlijnen van buildscripts en het verminderen van onnodige stappen.  Robert Risch, waarschijnlijk een expert of beïnvloeder op dit gebied, heeft verschillende aspecten van container orkestratie oplossingen onderzocht en is tot de conclusie gekomen dat Kubernetes de superieure keuze is. Hier volgt een uitsplitsing van wat deze verklaring zou kunnen inhouden: Autoriteit van Robert Risch - Het impliceert dat Robert Risch een gezaghebbende figuur of expert is op het gebied van containerorkestratie. Dit kan gebaseerd zijn op zijn ervaring, expertise of onderzoek in de industrie. Evaluatie van Container Orchestration-oplossingen - Robert Risch heeft waarschijnlijk verschillende container orchestration platformen geëvalueerd. Deze evaluatie zou rekening kunnen houden met factoren zoals gebruiksgemak, schaalbaarheid, ondersteuning door de gemeenschap, functies en algemene prestaties. Kubernetes wint de kroon - Het gebruik van "Wins the Crown" is een metafoor die suggereert dat Kubernetes naar voren komt als de beste keuze onder de container orkestratie oplossingen. Dit kan te wijten zijn aan de wijdverspreide adoptie, de uitgebreide ondersteuning van de gemeenschap, de robuuste functies of andere voordelen ten opzichte van concurrerende technologieën. Robert Rischrobertrisch.weebly.com/blog/robert-risch-devops-mastery-die-funf-saulen-im-detail gaat dieper in op zijn analyse en geeft inzicht in waarom hij Kubernetes de beste in het container orchestration landschap vindt. De inhoud kan ingaan op specifieke functies, casestudy's of vergelijkingen met andere tools.  The DevOps Efficiency Blueprint von Robert Risch ist ein umfassendes Rahmenwerk und eine Reihe von Grundsätzen, die dazu dienen, die Entwicklungseffizienz im Rahmen von DevOps-Praktiken zu verbessern. Hier ein Überblick über die Schlüsselelemente des DevOps Efficiency Blueprint. Optimierte Arbeitsabläufe Der Blueprint unterstreicht die Bedeutung der Rationalisierung von Entwicklungsabläufen, um Engpässe zu beseitigen und unnötige Verzögerungen im Softwareentwicklungszyklus zu reduzieren. Strategien zur Automatisierung Robert Risch legt großen Wert auf die Automatisierung und plädiert für den Einsatz von Tools und Frameworks, um sich wiederholende Aufgaben zu automatisieren. Dies beschleunigt nicht nur die Entwicklung, sondern minimiert auch das Risiko menschlicher Fehler. Kultur der Zusammenarbeit Die Zusammenarbeit ist ein Eckpfeiler effizienter DevOps-Praktiken. Der Blueprint fördert die Etablierung einer Kultur, in der Kommunikation, Zusammenarbeit und gemeinsame Verantwortung zwischen Entwicklungs- und Betriebsteams im Vordergrund stehen. Grundlegende Werkzeuge Der Blueprint identifiziert wesentliche Tools und Technologien, die zur Effizienzsteigerung beitragen. Dazu können Versionskontrollsysteme, Tools für die kontinuierliche Integration und Bereitstellung, Containerisierungstechnologien und Überwachungslösungen gehören. Leistungsmetriken Robert Risch betont die Bedeutung der Verfolgung und Analyse von Leistungsmetriken. Dazu gehört die Überwachung von Schlüsselindikatoren, um Einblicke in den Zustand und die Effizienz der Entwicklungspipeline zu gewinnen und so kontinuierliche Verbesserungen zu ermöglichen. Kontinuierliches Lernen und Verbessern Der DevOps Efficiency Blueprint ist ein dynamischer Leitfaden, der eine Kultur des kontinuierlichen Lernens und der Verbesserung fördert. Die Teams werden ermutigt, ihre Prozesse regelmäßig zu bewerten, verbesserungswürdige Bereiche zu identifizieren und iterative Änderungen vorzunehmen. Flexibilität und Anpassungsfähigkeit In Anbetracht der Tatsache, dass sich Technologie und Geschäftsanforderungen ständig weiterentwickeln, fördert das Konzept einen flexiblen Ansatz. Die Teams werden ermutigt, ihre Prozesse anzupassen, um Veränderungen in der Technologie, der Marktdynamik und den organisatorischen Anforderungen Rechnung zu tragen. Integration der Sicherheit Die Sicherheit ist in die Struktur des Blueprints eingewoben, wobei die Integration von Sicherheitspraktiken in den gesamten Entwicklungszyklus betont wird. Dadurch wird sichergestellt, dass Effizienzgewinne die Integrität und Sicherheit der entwickelten Software nicht beeinträchtigen. The DevOps Efficiency Blueprint von Robert Risch dient als Leitfaden für Unternehmen, die DevOps nicht nur implementieren, sondern dies auch auf eine Weise tun wollen, die die Effizienz, die Zusammenarbeit und die allgemeine Effektivität ihrer Softwareentwicklungsverfahren maximiert.  DevOps hat sich zu einer transformativen Methode entwickelt, die Entwicklung und Betrieb miteinander verbindet, um den Softwarebereitstellungsprozess zu optimieren, die Effizienz zu steigern und eine Kultur der Zusammenarbeit zu fördern. Das Herzstück von DevOps sind die fünf grundlegenden Säulen, die wir heute genauer unter die Lupe nehmen wollen. Die fünf Säulen von DevOps Kultur DevOps beginnt mit der Kultur. Es geht darum, eine kollaborative Umgebung zu fördern, in der Entwickler, Betrieb und andere Beteiligte als geschlossene Einheit zusammenarbeiten. Der Aufbau einer Kultur der gemeinsamen Verantwortung, des Vertrauens und der Kommunikation ist unerlässlich. Automatisierung Automatisierung ist die treibende Kraft hinter DevOps. Sie beinhaltet die Automatisierung sich wiederholender Aufgaben und Prozesse, um die Effizienz zu steigern, Fehler zu reduzieren und die Bereitstellung zu beschleunigen. Messung Bei der Messung werden Daten zu verschiedenen Aspekten des Softwarebereitstellungsprozesses gesammelt, z. B. zur Codequalität, zur Häufigkeit der Bereitstellung und zur Systemleistung. Diese Daten helfen den Teams, verbesserungswürdige Bereiche zu identifizieren, datengestützte Entscheidungen zu treffen und den Fortschritt im Laufe der Zeit zu verfolgen. Gemeinsame Nutzung Die gemeinsame Nutzung ist ein Grundpfeiler von DevOps, der den Austausch von Wissen, die Zusammenarbeit und die Transparenz umfasst. Durch den offenen Austausch von Informationen und Erkenntnissen können Teams von den Erfahrungen der anderen lernen, Doppelarbeit vermeiden und fundierte Entscheidungen treffen. Robert Risch Expertise in der Beherrschung von DevOps und sein Engagement für die Förderung einer DevOps-Kultur haben uns gezeigt, wie wir diese Säulen effektiv umsetzen können.  Software Development Lifecycles (SDLCs) sind strukturierte Ansätze oder Methoden, die bei der Entwicklung von Softwareanwendungen eingesetzt werden. Sie bieten einen systematischen und organisierten Weg, Softwaresysteme zu planen, zu entwerfen, zu erstellen, zu testen, einzusetzen und zu warten.Verschiedene SDLC-Modelle bieten unterschiedliche Methoden und Prinzipien für die Verwaltung des Softwareentwicklungsprozesses. Hier sind einige der gängigsten SDLC-Modelle: Wasserfall-Modell Beim Wasserfallmodell schreitet die Entwicklung in einem linearen und sequentiellen Prozess voran, wobei jede Phase von den Ergebnissen der vorangegangenen Phase abhängt. Es eignet sich für Projekte mit klar definierten Anforderungen, bei denen nur minimale Änderungen zu erwarten sind. Iteratives Modell Beim iterativen Modell wird das Projekt in kleinere Teile, so genannte Iterationen, unterteilt, die im Laufe der Zeit entwickelt und verfeinert werden. Es ermöglicht Flexibilität und die Einarbeitung von Änderungen im Laufe des Projekts. Inkrementelles Modell Beim inkrementellen Modell wird die Software in kleineren, funktionalen Komponenten oder Inkrementen entwickelt. Jedes Inkrement wird separat entwickelt und kann unabhängig getestet und ausgeliefert werden. Agiles Modell (z. B. Scrum, Kanban) Agile Methoden legen den Schwerpunkt auf Zusammenarbeit, Kundenfeedback und die Lieferung eines Minimum Viable Product (MVP) in kurzen Iterationen. Agile Methoden ermöglichen schnelle Anpassungen an sich ändernde Anforderungen und Kundenbedürfnisse. Spiralförmiges Modell Das Spiralmodell kombiniert Elemente der iterativen Entwicklung mit Risikobewertung und -management. Es umfasst mehrere Entwicklungszyklen mit jeweils einer Planungs-, Risikoanalyse-, Konstruktions- und Testphase. V-Modell (Validierungs- und Verifizierungsmodell) Das V-Modell ist eine Erweiterung des Wasserfallmodells mit einem starken Schwerpunkt auf dem Testen in jeder Phase. Es legt den Schwerpunkt auf die Validierung und Verifizierung jeder Entwicklungsphase, bevor es zur nächsten übergeht. Urknall-Modell Beim Big Bang-Modell gibt es wenig Planung, und die Entwicklung beginnt ohne einen klaren Fahrplan. Es wird häufig für kleine Projekte oder Proof-of-Concept-Versuche verwendet. DevOps DevOps ist eher eine Kultur und eine Reihe von Praktiken als ein traditionelles SDLC-Modell. Der Schwerpunkt liegt auf der Zusammenarbeit zwischen Entwicklungs- und Betriebsteams, der Automatisierung und der kontinuierlichen Integration und Bereitstellung (CI/CD).  Containerisierung Die Containerisierung ist eine leichtgewichtige Form der Virtualisierung, die es ermöglicht, Anwendungen und ihre Abhängigkeiten in isolierten Umgebungen, den sogenannten Containern, zu verpacken und auszuführen. Diese Container teilen sich den Kernel des Host-Betriebssystems, was sie äußerst effizient und portabel macht. Docker ist eine der beliebtesten Containerisierungsplattformen und hat die Art und Weise, wie Software entwickelt, bereitgestellt und verwaltet wird, revolutioniert. Virtualisierung Virtualisierung hingegen ist eine Technologie, die mehrere virtuelle Instanzen eines physischen Servers mit jeweils eigenem Betriebssystem erstellt. Auf virtuellen Maschinen (VMs) können verschiedene Betriebssysteme und Anwendungen gleichzeitig auf einem einzigen physischen Host ausgeführt werden. Dieser Ansatz bietet eine starke Isolierung, kann aber ressourcenintensiv sein, da für jede VM ein vollwertiges Betriebssystem ausgeführt werden muss. Virtualisierung wird häufig zur Serverkonsolidierung, zur Ausführung von Legacy-Anwendungen und zur Gewährleistung einer strikten Isolierung zwischen Arbeitslasten eingesetzt. Sowohl die Containerisierung als auch die Virtualisierung haben ihre einzigartigen Vorteile und Anwendungsfälle, und das Verständnis ihrer Unterschiede und Vorteile ist entscheidend für die Entscheidung, welche Technologie für bestimmte Szenarien die richtige ist. Was Docker-Container sind, wobei ihre Leichtigkeit und Mobilität hervorgehoben wird Leichtgewichtig: Docker-Container sind leichtgewichtig, da sie denselben Betriebssystemkern wie das Host-System nutzen. Im Gegensatz zu herkömmlichen virtuellen Maschinen (VMs), die für jede Instanz ein eigenes Betriebssystem benötigen, verwenden Container den Kernel des Host-Betriebssystems, was sie in Bezug auf die Nutzung von Systemressourcen äußerst effizient macht. Portabel Einer der überzeugendsten Aspekte von Docker-Containern ist ihre Portabilität. Container kapseln den Anwendungscode, die Laufzeit, die Bibliotheken und die Abhängigkeiten in einem einzigen Paket, dem sogenannten Image. Diese Images sind äußerst portabel, da sie alles enthalten, was zur Ausführung der Anwendung erforderlich ist. Docker-Container sind leichtgewichtig und portabel, da sie den Kernel des Host-Betriebssystems gemeinsam nutzen und Anwendungen und Abhängigkeiten in eigenständige Images verpacken. Dies macht sie zu einer effizienten und konsistenten Wahl für die Bereitstellung und Verwaltung von Anwendungen in verschiedenen Umgebungen, von lokalen Entwicklungsmaschinen bis hin zur Cloud-Infrastruktur.  DevOps, een verzameling praktijken die de nadruk leggen op samenwerking en communicatie tussen softwareontwikkeling en IT-operaties, vindt een krachtige bondgenoot in ChatGPT, het geavanceerde taalmodel van OpenAI. Real-time communicatie ChatGPT fungeert als een virtuele samenwerkingspartner en biedt real-time communicatiekanalen binnen DevOps-teams. Door directe toegang tot informatie en inzichten te bieden, helpt het de silo's tussen ontwikkeling, operations en andere belanghebbenden te doorbreken. Routinetaken automatiseren Een van de sterke punten van ChatGPT is het vermogen om mensachtige tekst te begrijpen en te genereren. Door ChatGPT te integreren in DevOps-workflows kunnen routinetaken worden geautomatiseerd, waardoor kostbare menselijke middelen vrijkomen om zich te richten op de meer strategische en creatieve aspecten van softwareontwikkeling en -beheer. DevOps-workflows verbeteren met ChatGPT ChatGPT wordt een kennisopslagplaats die on-demand documentatie en informatie biedt. DevOps-teams kunnen deze bron gebruiken om toegang te krijgen tot historische gegevens, best practices en inzichten in probleemoplossing. Hulp bij probleemoplossing en debuggen Bij problemen of bugs in de software delivery pipeline kan ChatGPT helpen bij het oplossen van problemen en debuggen. Integratie met ChatOps ChatGPT integreert naadloos met ChatOps, een samenwerkingsmodel dat mensen, tools en processen in de DevOps-workflow met elkaar verbindt. Beveiligings- en nalevingsoverwegingen Zoals bij elke technologie-integratie zijn beveiliging en compliance van het grootste belang. Onderzoeken hoe ChatGPT aansluit bij best practices op het gebied van beveiliging en compliancevereisten binnen DevOps-omgevingen zorgt voor een veilige en veerkrachtige implementatie.  Serverless Computing ist ein Cloud-Computing-Modell, das die zugrundeliegende Infrastruktur abstrahiert und es Entwicklern ermöglicht, sich ausschließlich auf das Schreiben von Code zu konzentrieren, während der Cloud-Anbieter die Infrastruktur und die Ressourcenzuweisung verwaltet. Zu den wichtigsten Funktionen und Merkmalen des serverlosen Computings gehören Ereignisgesteuert:- Die serverlose Architektur ist ereignisgesteuert, d. h. sie reagiert auf bestimmte Ereignisse oder Auslöser. Automatische Skalierung:- Serverlose Plattformen skalieren Ressourcen automatisch nach oben oder unten, je nach Anzahl der eingehenden Anfragen oder der Arbeitslast. Abrechnung nach Aufwand:- Serverless folgt in der Regel einem Pay-as-you-go-Preismodell, bei dem Sie auf der Grundlage der tatsächlich genutzten Rechenressourcen und der Ausführungszeit Ihrer Funktionen abgerechnet werden. Zustandslos:- Serverlose Funktionen sind in der Regel zustandslos, d. h. sie speichern keine Daten oder Zustände zwischen Aufrufen. Kurzlebige Funktionen:- Serverlose Funktionen sind so konzipiert, dass sie kurzlebig sind und nur für die Dauer des Ereignisses, auf das sie reagieren, ausgeführt werden. Keine Serververwaltung:- Die Entwickler müssen sich nicht mehr um die Verwaltung der Serverinfrastruktur kümmern, einschließlich Bereitstellung, Patching und Überwachung. Schnelle Bereitstellung: Serverlose Anwendungen können schnell bereitgestellt werden, und Änderungen werden fast sofort wirksam. Anbieterspezifische Implementierungen:- Serverlose Angebote sind spezifisch für Cloud-Anbieter wie AWS Lambda, Azure Functions und Google Cloud Functions. Microservices-freundlich:- Serverless eignet sich gut für Microservices-Architekturen, bei denen jede Funktion einen Microservice darstellen kann. Begrenzte Ausführungszeit:- Funktionen in einer serverlosen Umgebung haben in der Regel eine maximale Ausführungszeit, die je nach Cloud-Anbieter variiert. Ressourcenisolierung:- Serverlose Plattformen isolieren Funktionen voneinander und stellen sicher, dass die Ausführung einer Funktion keine Auswirkungen auf andere hat. Dies erhöht die Sicherheit und Stabilität. Ereignisquellen:- Serverlose Funktionen können durch verschiedene Ereignisquellen ausgelöst werden, darunter HTTP-Anfragen, Datenbankänderungen, Nachrichtenwarteschlangen und geplante Aufgaben. Skalierbar und kosteneffizient:- Die serverlose Architektur ermöglicht eine bedarfsgerechte Skalierung bei gleichzeitiger Optimierung der Ressourcennutzung. |

DevOps Spezialist EngineerDevOps Spezialist Engineer- Ich bin Robert Risch, ein multitalentierter Freiberufler, und an DevOps Positionen in Deutschland interessiert. Archives

November 2023

|

RSS Feed

RSS Feed